فهرست مطالب

سایبر یونی

اشتراک گذاری:

فهرست مطالب

در عصر حاضر، هوش مصنوعی (AI) به سرعت در حال پیشرفت است و تاثیرات شگرفی بر جنبههای مختلف زندگی ما میگذارد. با این حال، این پیشرفتها نگرانیهایی را در مورد ایمنی هوش مصنوعی (AI safety) و ریسکهای مرتبط با آن ایجاد کرده است. در میان شرکتهای پیشرو در این حوزه، آنتروپیک (Anthropic) با رویکردی منحصربهفرد، خود را در خط مقدم ایمنی این فناوری قرار داده است. این مقاله به بررسی نقش آنتروپیک در تضمین ایمنی هوش مصنوعی، چالشها و فرصتهای پیش رو میپردازد.

هوش مصنوعی، بهویژه مدلهای زبانی بزرگ (LLMs)، پتانسیل بالایی برای ایجاد تغییرات مثبت در جامعه دارند. با این وجود، این فناوریها میتوانند عواقب ناخواستهای نیز داشته باشند، از جمله انتشار اطلاعات نادرست، سوء استفادههای احتمالی و خطرات امنیتی. بنابراین، توسعه ایمن هوش مصنوعی، امری ضروری است. این امر مستلزم درک عمیق از ریسکهای احتمالی و اتخاذ رویکردهای فعالانه برای کاهش آنهاست.

آنتروپیک یک شرکت تحقیقاتی و مهندسی هوش مصنوعی است که بر روی ایمنی هوش مصنوعی تمرکز دارد. این شرکت توسط محققان سابق OpenAI تأسیس شده و هدف آن ایجاد هوش مصنوعی قابل اعتماد و ایمن است. رویکرد آنتروپیک بر پایه سه رکن اصلی بنا شده است:

آنتروپیک با توسعه مدلهای زبانی خود، مانند Claude، تلاش میکند تا این اصول را عملی سازد. این مدلها بهگونهای طراحی شدهاند که از طریق تکنیکهایی مانند یادگیری تقویتی از نظرات انسانی (RLHF) و ساختارهای مهندسی پیشرفته، رفتارشان کنترل شود و در جهت منافع بشر عمل کنند.

ایجاد هوش مصنوعی ایمن، با چالشهای متعددی همراه است. برخی از این چالشها عبارتند از:

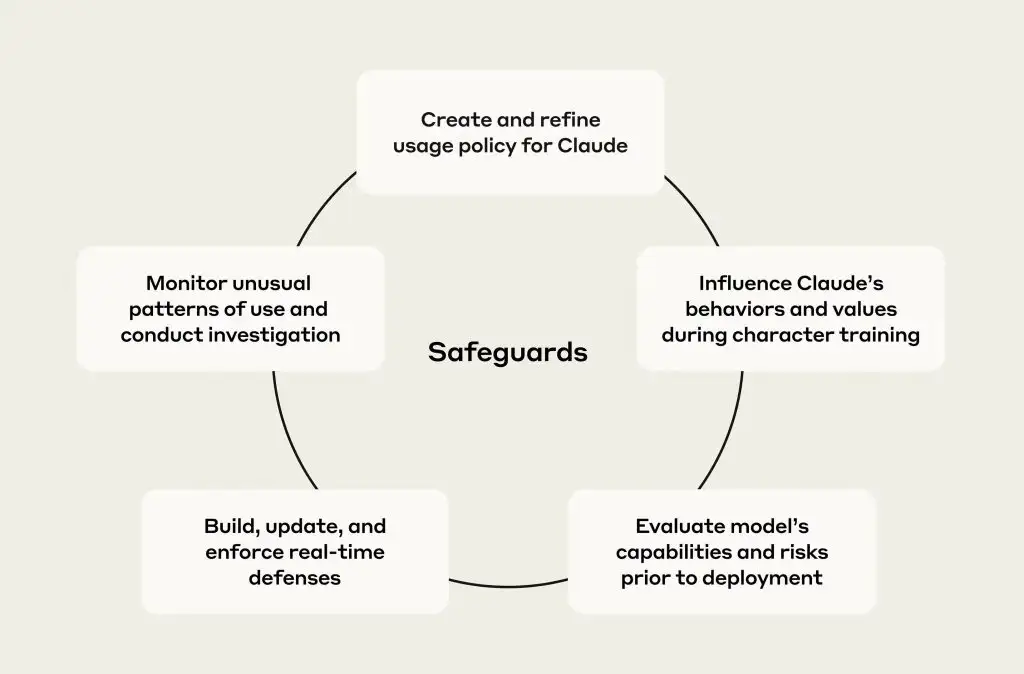

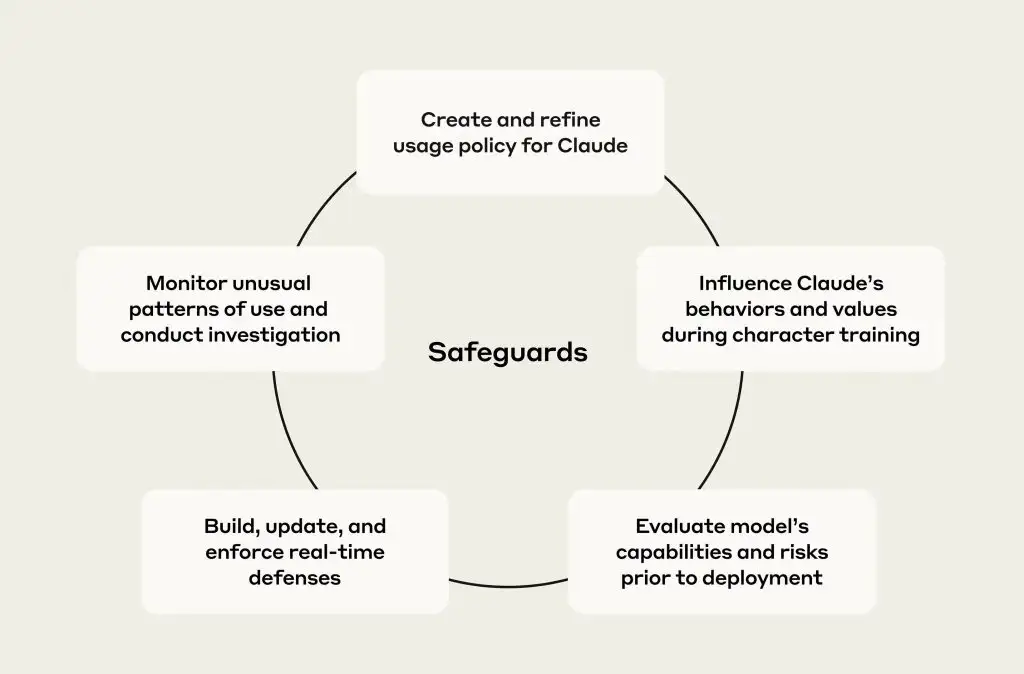

آنتروپیک برای مقابله با این چالشها، رویکردی جامع را در پیش گرفته است. این رویکرد شامل موارد زیر میشود:

جدول زیر، مقایسهای بین برخی از مدلهای زبانی برتر، با تمرکز بر ویژگیهای ایمنی و عملکرد، ارائه میدهد:

| مدل زبانی | شرکت سازنده | ویژگیهای ایمنی | عملکرد (بهطور کلی) |

|---|---|---|---|

| Claude | آنتروپیک | RLHF، یادگیری از شواهد، تمرکز بر کاهش سوگیریها، ایمنی بیشتر | عالی (در مقایسه با رقبا) |

| GPT-4 | OpenAI | تا حدی ایمن، مکانیزمهای کاهش سوگیری، بهبودهای امنیتی | بسیار خوب |

| Bard | مکانیزمهای ایمنی، تلاش برای کاهش سوگیریها | خوب |

آینده هوش مصنوعی روشن و در عین حال پیچیده است. با پیشرفتهای سریع در این حوزه، امنیت هوش مصنوعی بیش از پیش اهمیت مییابد. آنتروپیک با تمرکز بر تحقیقات ایمنی، توسعه مدلهای زبانی مسئولانه و همکاری با دیگران، نقش مهمی در شکلدهی به این آینده ایفا میکند. این شرکت قصد دارد تا با ارائه راهحلهای نوآورانه و استانداردهای ایمنی، اطمینان حاصل کند که هوش مصنوعی به نفع بشریت عمل میکند.

آنتروپیک با رویکردی پیشرو و متمرکز بر ایمنی، خود را در خط مقدم ایمنی هوش مصنوعی قرار داده است. تحقیقات عمیق، توسعه مدلهای زبانی مسئولانه و همکاریهای گسترده، از جمله عوامل موفقیت آنتروپیک هستند. با ادامه این تلاشها، آنتروپیک میتواند نقش مهمی در ایجاد آیندهای امنتر و پایدارتر برای هوش مصنوعی ایفا کند.

آنتروپیک بر خلاف بسیاری از شرکتهای دیگر، تمرکز ویژهای بر روی ایمنی هوش مصنوعی و توسعه مدلهای زبانی ایمن دارد. این شرکت، تحقیقات گستردهای را در این زمینه انجام میدهد و در تلاش است تا با استفاده از رویکردهای نوآورانه، ریسکهای مرتبط با هوش مصنوعی را کاهش دهد.

آنتروپیک از تکنیکهای مختلفی برای ارتقاء ایمنی مدلهای زبانی خود استفاده میکند، از جمله یادگیری تقویتی از نظرات انسانی (RLHF) و یادگیری از شواهد (Constitutional AI). این تکنیکها به منظور هدایت مدلها به سمت رفتارهای مطلوب و کاهش ریسکهای احتمالی، به کار گرفته میشوند.

هیچ سیستمی کاملاً ایمن نیست. با این حال، آنتروپیک با انجام تحقیقات گسترده، توسعه مدلهای زبانی مسئولانه و ارزیابیهای دقیق، در تلاش است تا ریسکهای مرتبط با هوش مصنوعی را به حداقل برساند. این شرکت به طور مداوم در حال بهبود و ارتقاء امنیت مدلهای خود است.

گوگل در حال آزمایش تیک های تایید در قسمت جستجو است

گوگل در حال آزمایش یک...

نویسنده: سایبر یونی

تاریخ انتشار: جمعه ۱۳ مهر ۱۴۰۳

چالشها و موفقیتهای سامسونگ در صنعت چیپسازی و هوش مصنوعی

در این مقاله، به بررسی...

نویسنده: سایبر یونی

تاریخ انتشار: سهشنبه ۱۷ مهر ۱۴۰۳

Data Entry چیست و چگونه آن را یاد بگیریم؟ (راهنمای کامل ورود اطلاعات)

در این مقاله به بررسی...

نویسنده: مهدی یعقوبی زاده

تاریخ انتشار: سهشنبه ۱۸ دی ۱۴۰۳